生成AI――とりわけChatGPT――は、営業資料の作成やメール文案の作成など、多くの業務シーンで活用が広がっています。

しかし、「会社の機密情報を入力しても大丈夫なのか?」「情報が漏洩したらどうしよう?」という不安の声も少なくありません。

本記事では、中小企業の経営者・担当者の方に向けて、生成AIを安心して業務に活用するための具体的なセキュリティ対策をわかりやすく解説します。

ChatGPTの情報管理の仕組みを正しく理解する

まず押さえておきたいのは、ChatGPTがユーザーの入力情報をどのように扱っているかという点です。

無料版・Plus版の情報管理

OpenAIの公式ポリシーによると、無料版およびPlus版(月額20ドル) では、ユーザーが入力したプロンプト(質問や指示)が、AIモデルの改善・学習に利用される可能性があります。

ただし、以下の点も押さえておきましょう。

- 会話履歴は30日間保存後に削除される方針

- ユーザー自身でいつでも会話履歴を削除可能

- 設定から「モデル学習への利用」をオフにできる

⚠️ 重要: 設定をオフにしても、すでに入力済みの情報には遡って適用されません。機密情報は最初から入力しないことが鉄則です。

企業向けプラン(Enterprise / Team)の違い

ChatGPT Enterprise や ChatGPT Team といった法人向けプランでは、セキュリティレベルが大幅に強化されています。

| 項目 | 無料版・Plus | Enterprise・Team |

|---|---|---|

| 入力データの学習利用 | あり(オプトアウト可) | なし(デフォルトで除外) |

| データ暗号化 | 基本的な暗号化 | AES-256(保存時)、TLS 1.2+(転送時) |

| 管理者機能 | なし | SSO、SCIM、ロールベース権限管理 |

| コンプライアンス対応 | 限定的 | SOC 2 Type 2、ISO 27001認証取得 |

| データレジデンシー | 選択不可 | 日本を含む各国対応 |

2024年以降、ChatGPT EnterpriseはMicrosoft Purviewとの連携や、Compliance APIによるログ監査機能も追加され、金融・医療・法務などの規制業界でも導入が進んでいます。

実際に起きた情報漏洩リスクの事例

「本当に情報漏洩のリスクがあるの?」という疑問に対して、実際に報告されている事例を紹介します。

事例1:大手電機メーカーの機密コード流出懸念

韓国のサムスン電子では、従業員がChatGPTに社内の機密コードを入力したことが問題となり、社内でのChatGPT利用が一時禁止される事態となりました。

事例2:欧州での利用規制

イタリアでは、プライバシー保護の観点からChatGPTの利用が一時的に禁止されました。これは、入力データの取り扱いに対する懸念が背景にあります。

事例3:画像からの情報推測リスク(2025年の新たな脅威)

2025年に入り、ChatGPTの画像解析機能が強化されたことで、写真から位置情報や個人情報を推測する能力が向上しています。SNSに投稿された画像をAIに分析させることで、撮影場所や生活環境が特定されるリスクも指摘されています。

🚨 注意: 業務で使用する画像(名刺、社内風景、製品写真など)にも機密情報が含まれている可能性があります。画像のアップロードにも十分注意しましょう。

今日から実践できる!AIセキュリティ5つの基本対策

では、具体的にどのような対策を取ればよいのでしょうか。中小企業でもすぐに実践できる対策を5つご紹介します。

対策1:情報の匿名化・抽象化を徹底する

AIに入力するデータは、必ず匿名化および抽象化を行いましょう。

具体的な方法

- 実際の顧客名や企業名 → 「A社」「B社」に置き換え

- 具体的な数値 → 「約○○%増加」などの概数表現に変換

- 個人名 → 「担当者」「クライアント」などに差し替え

- メールアドレス・電話番号 → 完全に削除

例:営業報告をChatGPTで要約する場合

❌ NG例:「株式会社山田製作所の田中部長から、来月の発注額が500万円になると連絡がありました」

✅ OK例:「取引先A社の担当者から、来月の発注額が前月比120%になると連絡がありました」

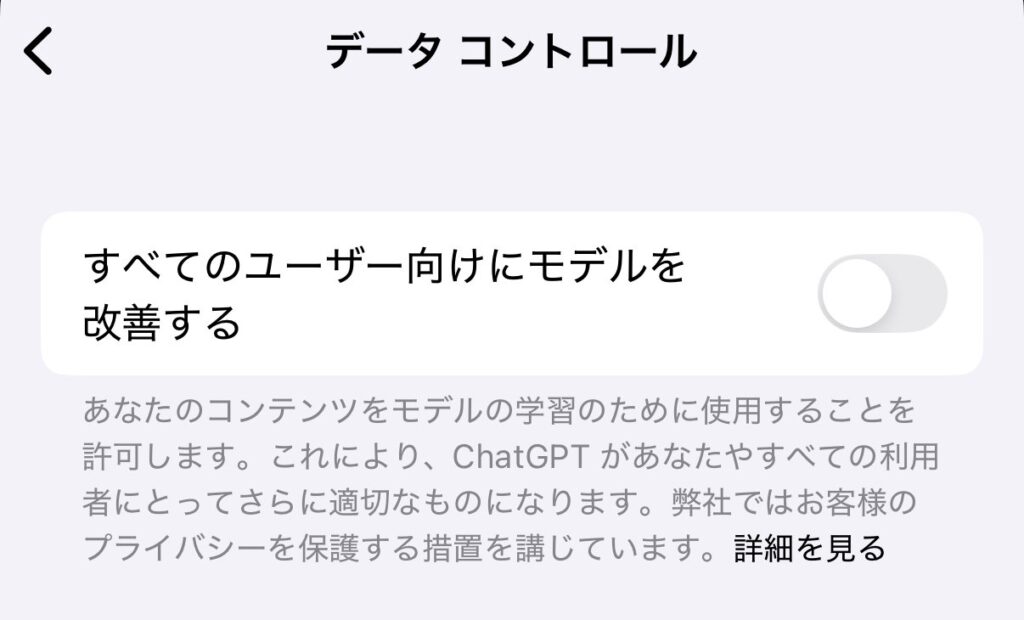

対策2:ChatGPTのプライバシー設定を見直す

無料版やPlus版を使用している場合は、必ず以下の設定を確認してください。

設定手順

- ChatGPTにログインし、左下のアカウントアイコンをクリック

- 「Settings(設定)」を選択

- 「Data controls(データコントロール)」を開く

- 「Improve the model for everyone」をオフに切り替え

この設定をオフにすることで、今後入力するプロンプトがモデル学習に使用されなくなります。

対策3:用途に応じたプランを選択する

業務での利用頻度や取り扱うデータの機密性に応じて、適切なプランを選択しましょう。

プラン選択の目安

- 個人利用・学習目的 → 無料版でOK(機密情報は入力しない)

- 一般的な業務利用 → ChatGPT Plus + 設定のオプトアウト

- 機密性の高い業務 → ChatGPT Team(月額25ドル/人〜)

- 全社導入・コンプライアンス重視 → ChatGPT Enterprise

対策4:API版の活用を検討する

自社システムとの連携や、より高度なセキュリティが必要な場合は、API版の利用を検討しましょう。

API版では、入力データがモデルの学習に利用されないことが公式に保証されています(2025年現在のOpenAIポリシー)。

対策5:代替ツールの活用

ChatGPT以外にも、セキュリティを重視した選択肢があります。

- Microsoft 365 Copilot: 組織のセキュリティポリシーに準拠した運用が可能

- Google Gemini for Workspace: Googleのエンタープライズセキュリティ基盤を活用

- プライベートGPT: 自社サーバー内でのみ稼働するAIモデルを構築

社内AIガイドラインの作成ポイント

組織的にAIを活用するためには、明確な社内ガイドラインの策定が不可欠です。

ガイドラインに盛り込むべき項目

必須項目

- AIツールに入力可能な情報と禁止情報の明確な区分

- 情報の匿名化・抽象化のルールと具体例

- 利用可能なAIツールのリスト(許可制にするか)

- 利用が推奨される業務シーンと禁止される業務シーン

推奨項目

- 情報漏洩が発生した場合の報告・対応フロー

- 定期的なセキュリティ教育の実施計画

- AIの出力内容に対する人間によるチェック体制

- ガイドラインの定期見直しスケジュール

【参考】入力情報の分類例

| 分類 | 具体例 | AI入力 |

| 🟢 入力OK | 一般的な質問、公開情報の要約、文章の校正 | ◯ |

| 🟡 匿名化必須 | 営業報告、顧客対応履歴、社内会議メモ | △(加工後) |

| 🔴 入力禁止 | 顧客の個人情報、契約書原本、財務データ、パスワード | ✕ |

知っておくべきAI関連法規制の最新動向(2025年)

AIセキュリティを考える上で、法規制の動向も把握しておきましょう。

EU AI法(AI Act)の施行状況

EUでは2024年8月にAI法が発効し、2025年2月から段階的に適用が開始されています。

施行スケジュール

- 2025年2月〜: 禁止されるAIシステム(ソーシャルスコアリング等)の規制開始

- 2025年8月〜: 汎用AI(GPAIモデル)への透明性義務適用

- 2026年8月〜: ハイリスクAIシステムへの本格規制開始

EU向けにサービスを提供している企業は、域外適用の対象となる可能性があるため注意が必要です。

日本の動向

日本では2025年6月に「AI基本法」が公布されました。これは直接的な規制法ではなく、AI戦略の推進を目的とした基本法ですが、今後の規制強化の土台となる可能性があります。

また、個人情報保護法の改正により、AI利用に関する規制が強化される可能性も指摘されています。

よくある質問(FAQ)

Q1. ChatGPTに入力した情報は完全に削除できますか?

ChatGPTには会話履歴の削除機能があり、OpenAIへのデータ削除依頼も可能です。ただし、バックアップやログに残存する可能性があるため、完全な消去は保証されません。重要な情報は最初から入力しないことが最も確実な対策です。

Q2. 無料版と有料版でセキュリティレベルは違いますか?

基本的なプライバシーポリシーは共通ですが、ChatGPT Enterpriseでは入力データがモデル学習に一切使用されないなど、より強固なセキュリティ機能が提供されています。中小企業であれば、まずはChatGPT Teamから検討するのがおすすめです。

Q3. 社内でAIツールを全面禁止すべきでしょうか?

一律禁止よりも、適切なガイドラインと教育を整備して安全に活用できる環境を構築する方が望ましいでしょう。AIツールは業務効率化に大きく貢献する可能性があり、禁止することで競争力を失うリスクもあります。

Q4. 自社専用のAIを構築するメリットはありますか?

プライベートGPTなど自社専用のAIを構築することで、データ漏洩リスクを大幅に低減でき、自社業務に特化した学習も可能になります。ただし、構築・保守のコストと技術的ハードルが高いため、機密性の高いデータを大量に扱う企業に適した選択肢です。

まとめ:AIを「安心して使い倒す」ために

生成AIは、正しく使えば中小企業の業務効率化に大きく貢献するツールです。

本記事のポイント

- 入力前に匿名化・抽象化を徹底する

- プライバシー設定を必ず見直す

- 機密性に応じたプラン選択を行う

- 社内ガイドラインを策定・周知する

- 法規制の動向もウォッチする

AIセキュリティは「禁止」ではなく「適切な管理」がカギです。本記事の対策を参考に、生成AIを安全かつ効果的に活用していきましょう。

コメント