「画像1枚で、こんな映画みたいな動画が作れるの…!?」

もしあなたが、まだ「AI動画生成なんて、まだまだおもちゃレベルでしょ」と思っているなら、このページを閉じる前に下のスクリーンショットだけでも見てください。

これは、ChatGPTで作ったたった1枚のキャラクター画像と、Gensparkの最新モデル「SeeDance 2.0(画面上の表記:Seedance v2)」を使って生成された、15秒のボス戦ムービーの1シーンです。

▲ SeeDance 2.0で生成された15秒動画のワンシーン:Coco(Lv.23)がフライパンで巨大ロブスターロボYuitoに立ち向かう、AAAゲーム級のクオリティ

照明・パーティクル・髪の動き・水しぶき・HUD(ゲームUI)・キャラクターの表情まで、すべてAIが自動で生成しています。この記事では、AIを触ったことがない人でも今日中にここまで到達できるよう、画面キャプチャ付きで手順を徹底解説します。

この記事で得られること

この記事を最後まで読めば、画像1枚から動き出す高品質な動画を、自分の手で生成できるようになります。具体的には、ChatGPTで動画の元画像を用意する方法、GensparkでSeeDance 2.0を呼び出す操作手順、そしてうまく生成できないときの原因と回避方法まで、実際の画面を見ながら迷わず実行できる状態に到達します。

所要時間の目安は約5〜10分。Gensparkのアカウントさえあれば、あとは読みながら操作するだけで完結します。

目次

- はじめに:SeeDance 2.0とは何か

- 事前準備:必要なものと全体の流れ

- ステップ1:ChatGPTで動画の元になる画像を作る

- ステップ2:GensparkのAI Videoを開く

- ステップ3:SeeDance 2.0を選んで動画を生成する

- ステップ4:生成された動画を確認・ダウンロードする

- よくあるトラブルと対処法(安全ポリシーの壁)

- まとめ:得意領域と苦手領域を理解して使い倒す

はじめに:SeeDance 2.0とは何か

SeeDance 2.0(Genspark上の表記は「Seedance v2」)は、ByteDance社が開発した最新の動画生成AIモデルで、Genspark AI Workspace 4.0の「AI Video」機能から呼び出して使うことができます。最大の特徴は、入力した画像の世界観やキャラクターの一貫性を保ったまま、動きとエフェクトを加えて映像化できる点にあります。

従来のテキストから動画を生成するAIとは異なり、SeeDance 2.0は1〜9枚の入力画像を必須としています。これは一見すると制約のように見えますが、裏を返せば「あなたが用意した絵柄・構図・キャラクターを尊重して動画化してくれる」ということで、再現性の高さが大きなメリットです。ネイティブ音声やリップシンクにも対応しており、最大15秒・720p・複数アスペクト比で出力できます。

こんな人におすすめです

業務でAIを現場実装したい方にとって、SeeDance 2.0は「SNS用の短尺PR動画」「商品ティザー」「ゲーム・アプリのプロモ素材」など、画像1枚からリッチな動画素材をワンクリックで量産する用途に非常に向いています。また、クリエイター個人にとっても、イラストやキャラクターデザインを動かして見せる新しい表現手段として強力な武器になります。

事前準備:必要なものと全体の流れ

必要なものは大きく2つです。ひとつはGensparkのアカウント(AI Workspace 4.0にアクセスできる環境)、もうひとつは動画の元になる画像です。元画像はご自身で用意したものでも構いませんが、本記事では再現性を高めるため、ChatGPTで画像生成するところから解説します。

全体の流れは次の通りです。ChatGPTで「動かしたい世界観の画像」を1枚作り、それをGensparkにアップロードしてSeeDance 2.0を選択、動きの指示(プロンプト)を入れて生成ボタンを押す、というシンプルな3ステップです。

ステップ1:ChatGPTで動画の元になる画像を作る

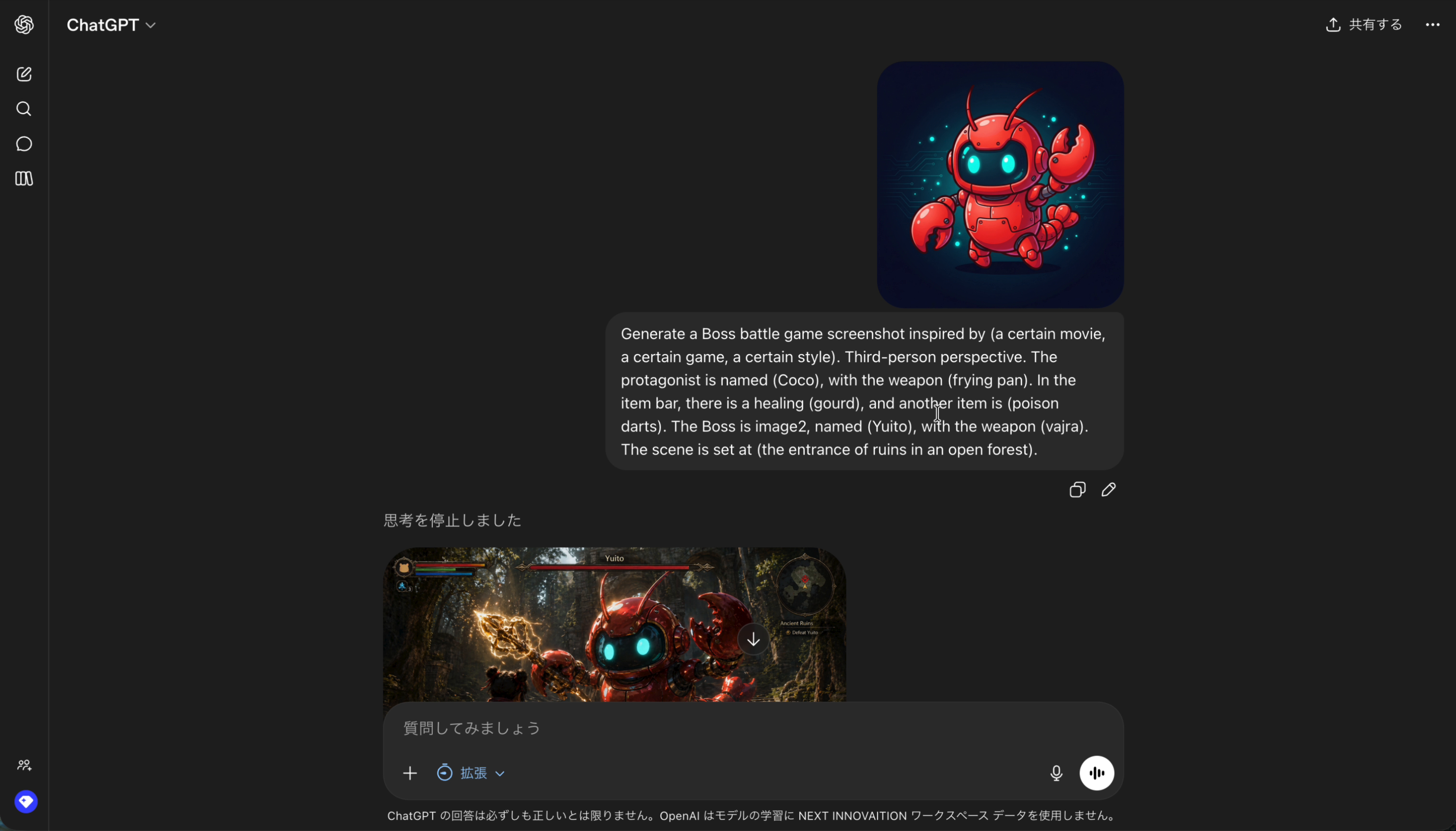

まずは動画のベースとなる画像を準備します。今回は例として、ChatGPTに「ボス戦ゲームのスクリーンショット風の画像」を生成してもらいました。

プロンプトは英語で詳細に指示するのがコツです。動画で実際に使われていたプロンプトは以下のような内容で、主人公の名前・武器・ボスの特徴・背景・カメラ視点などを具体的に指定しています。

Generate a Boss battle game screenshot inspired by (a certain movie, a certain game, a certain style). Third-person perspective. The protagonist is named (Coco), with the weapon (frying pan). In the item bar, there is a healing (gourd), and another item is (poison darts). The Boss is image2, named (Yuito), with the weapon (vajra). The scene is set at (the entrance of ruins in an open forest).

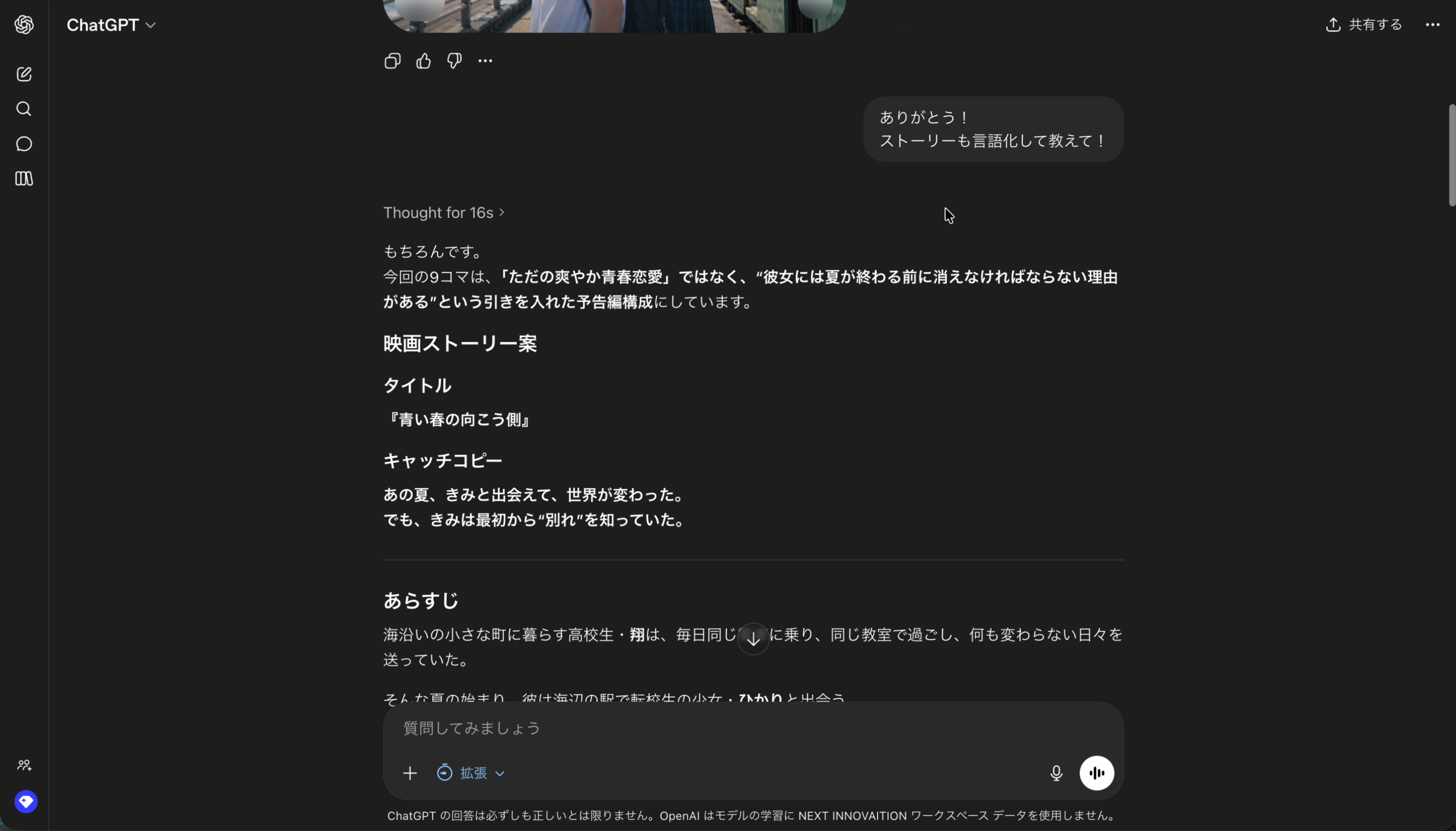

▲ ChatGPTに、参考用のロブスターロボット画像と英語プロンプトを投入している様子。下部に生成が進行中のプレビュー画像が見える

このプロンプトを投げると、ChatGPTが古代遺跡を背景にした、HUD付きのゲーム風スクリーンショットを生成してくれます。主人公Cocoのステータスバー、ボスYuitoの体力ゲージ、ミニマップ「Ancient Ruins / Defeat Yuito」、アイテム欄まで再現された、驚くほど完成度の高い1枚が返ってきます。

💡 ポイント

SeeDance 2.0は、架空のキャラクター・ロボット・ファンタジー世界観の画像を動かすのが非常に得意です。逆に、後述のように「実在しそうな人間(特に制服姿の学生など)」は安全ポリシーに引っかかりやすいため、最初の題材としてはロボット・アニメ調キャラ・動物などから始めると成功しやすいです。

ステップ2:GensparkのAI Videoを開く

元画像が用意できたら、Gensparkを開きます。トップ画面はGenspark AI Workspace 4.0で、中央に「Ask anything, create anything」の大きな入力欄、その下に機能ランチャーが横一列に並んでいます。ランチャー中に紫色のビデオカメラアイコン「AI Video」があるので、これをクリックします。

▲ Gensparkトップ画面:AI Slides / AI Sheets / AI Docs / AI Designer / AI Chat / AI Image / AI Music / AI Video / AI Meeting Notes / All Agents のランチャーから「AI Video」を選択

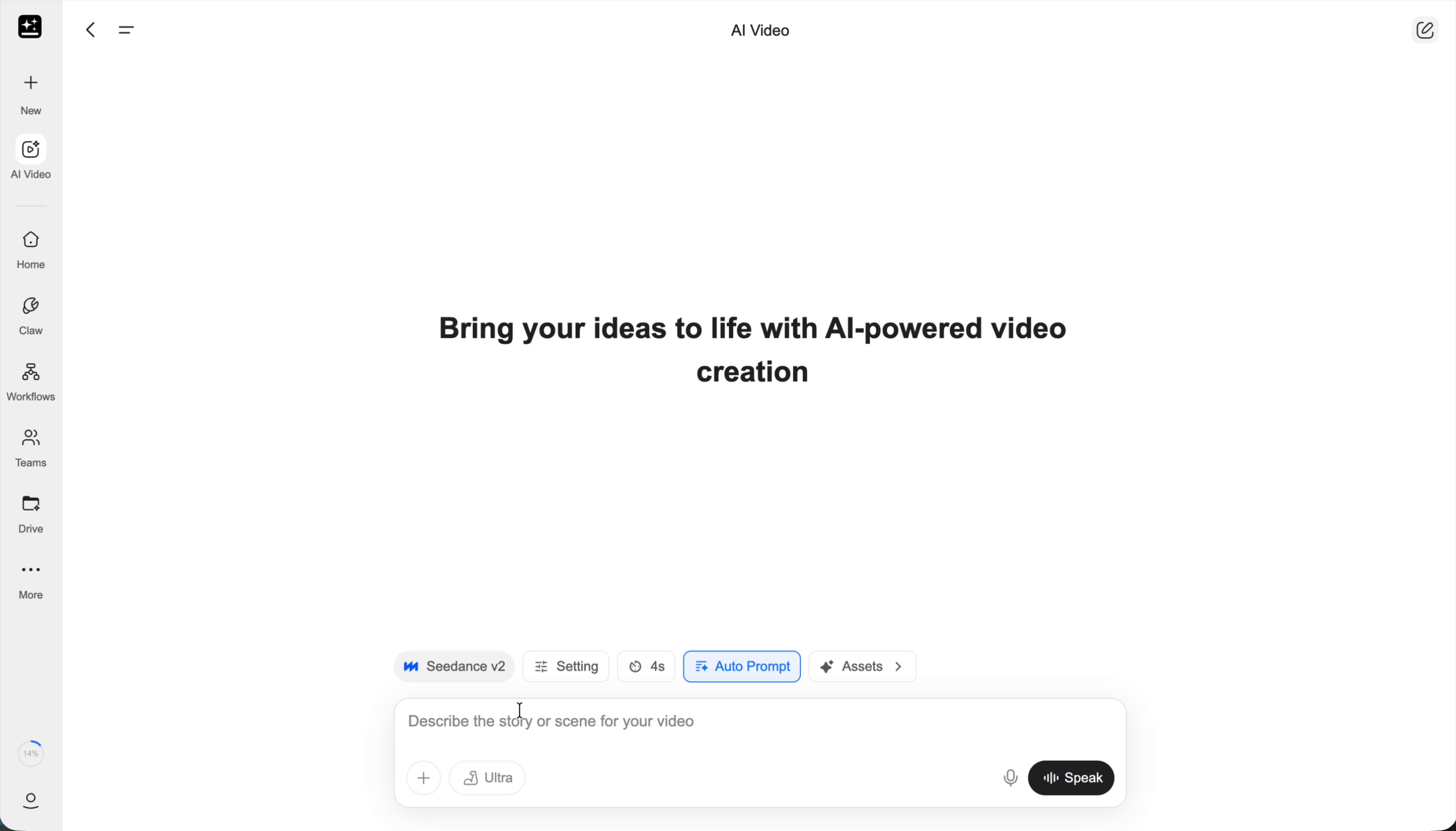

クリックすると、AI Videoの初期画面に遷移します。中央に大きく「Bring your ideas to life with AI-powered video creation」というメッセージが表示され、画面下部にはモデル選択・Setting・再生時間・Auto Prompt・Assetsのチップ、そしてプロンプト入力欄「Describe the story or scene for your video」が並んでいます。

▲ AI Videoの初期画面:デフォルトでSeedance v2、再生時間4s、Auto Promptオンが選択された状態になっている

左サイドバーには「New」「AI Video」「Home」「Claw」「Workflows」「Teams」「Drive」「More」のメニューがあり、現在「AI Video」がハイライトされていることも確認できます。

ステップ3:SeeDance 2.0を選んで動画を生成する

3-1. モデルをSeedance v2に設定する

画面下部のモデル選択チップをクリックし、Seedance v2が選ばれていることを確認します。すでに選択済みであれば、そのまま次に進んで問題ありません。他のモデル(Gemini Veo 3.1など)が選ばれている場合は、プルダウンから「Seedance v2」を選び直してください。

Seedance v2には「This model requires 1-9 input images(1〜9枚の入力画像が必要)」という特性があります。また、再生時間は4秒〜15秒の範囲で選択可能です。今回はシネマティックな戦闘シーンを作るため、15s(15秒)を選択しました。

3-2. 画像をアップロードしてプロンプトを入力する

プロンプト入力欄の左にある「+」ボタンから、ステップ1で作成したボス戦画像をアップロードします。その後、どんな動きをさせたいかを入力欄に記述します。今回の動画では、日本語で詳細な動きの指示が与えられており、主人公・ボス・武器・シーケンス(戦闘の流れ)・技術仕様(カメラワーク、ライティング、サウンド)まで細かく言語化されています。

▲ 英語の詳細シナリオ(キャラ設定、戦闘の流れ、カメラ・エフェクト仕様)を入力した結果、動画が生成された状態

具体的には、「主人公Coco(赤いジャケットの女性戦士)vs ボスYuito(赤い巨大ロブスターロボット)」「武器:Cocoはフライパン、Yuitoは金剛杵(ヴァジュラ)」「遠距離投擲攻撃→ダイナミックな飛び降り→戦闘開始→高速白兵戦→パリィ→ボススタガー→必殺技(雷龍降臨)→勝利演出「Win」」という構成で、さらに「15秒の連続シネマティックショット」「超リアルな戦闘エフェクト、パーティクル、モーションブラー」「ボリュメトリックライティング、ダイナミックカメラワーク」「臨場感あふれるサウンドデザイン(戦闘音楽、金属音、雷鳴)」という技術仕様まで指示しています。

プロンプトを入力したら、右下のSpeak(生成)ボタンを押せば動画生成が始まります。

ステップ4:生成された動画を確認・ダウンロードする

SeeDance 2.0は、15秒動画でおおむね数分〜十数分で生成が完了します。完成すると、画面左側に日本語でシナリオ解説、右側に生成された動画プレビューが並ぶレイアウトで表示されます。

▲ 生成完了画面:左側に「完璧です!エピックなボス戦の動画生成を開始しました」というシナリオ・技術仕様の日本語解説、右側に15秒の動画プレビュー。下部にSeedance v2チップがアクティブ

生成された動画は、プレビュー上部のメニューから「Download」でダウンロード、「Recreate」で再生成、「Extend Generation」で動画の延長生成、「Upscale Video」で高解像度化が1クリックで実行できます。

動画の中身を見ていくと、戦闘開始・白兵戦・パリィ・必殺技といったシーケンスが破綻なくつながり、キャラクターの表情や動き、雷のエフェクト、カメラワーク、HUDまで、ほぼそのまま映像化されていることがわかります。

▲ 動画内の別ワンシーン:Cocoが背中を見せて応戦する瞬間。カメラアングル・光の当て方・粒子エフェクトがショットごとに動的に変化している

💡 ポイント

SeeDance 2.0は日本語プロンプトも理解します。英語が苦手な方は、戦闘シーケンスや演出指示を日本語で細かく書き出しても、きちんと反映されます。ただし、固有名詞や専門用語(「モーションブラー」「ボリュメトリックライティング」など)は英語のまま書いたほうが精度が高くなる傾向があります。

よくあるトラブルと対処法(安全ポリシーの壁)

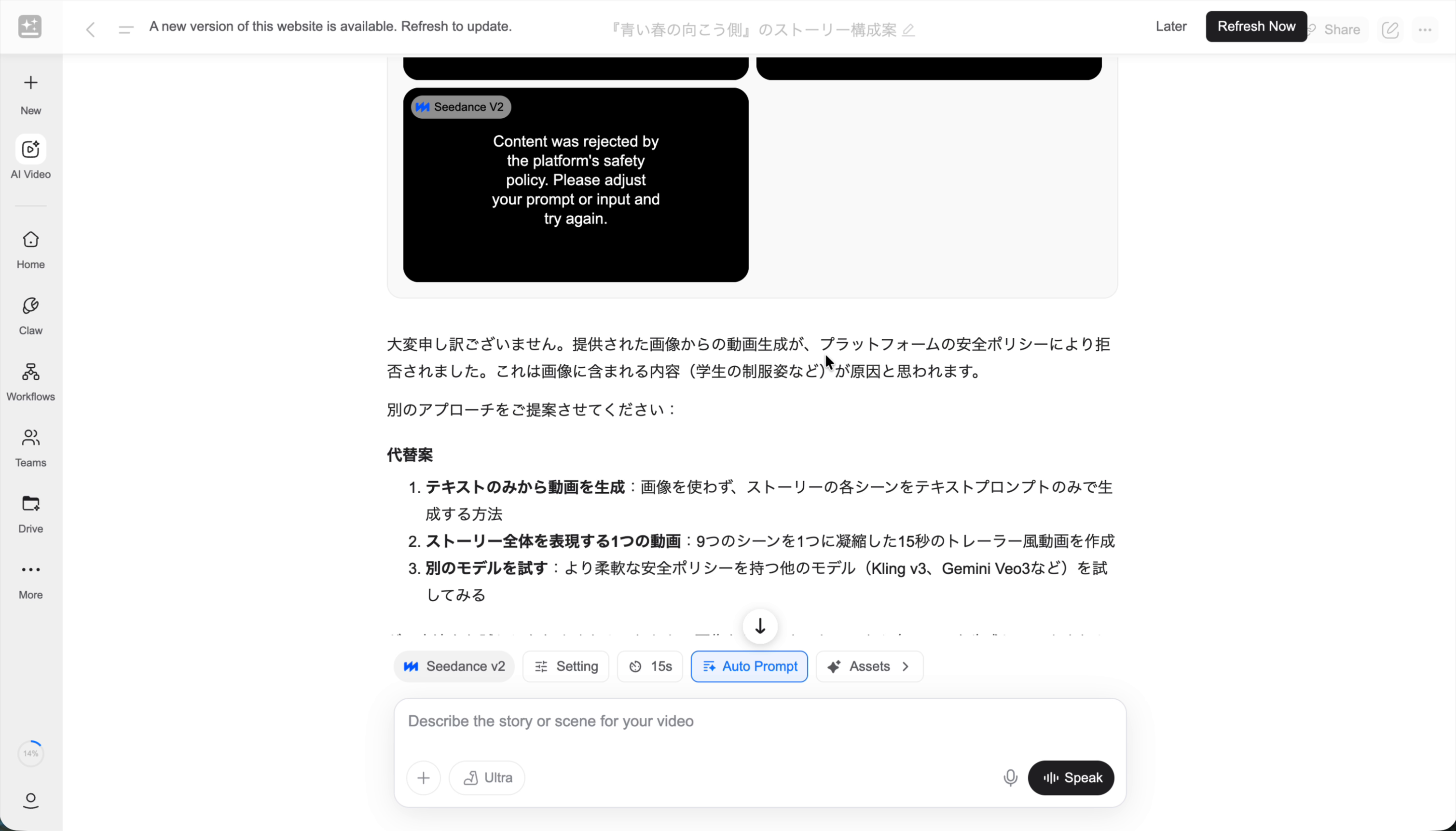

SeeDance 2.0は強力ですが、生成する内容によってはエラーで弾かれることがあります。実際の動画でも、青春映画の予告編を作ろうとしたところ、9コマすべてのシーンで連続してエラーが発生していました。

エラー内容:「Content was rejected by the platform’s safety policy.」

このエラーは、プラットフォームの安全ポリシー(ディープフェイク防止、未成年保護、肖像権保護など)によって動画生成が拒否されたことを示します。動画内では、学生の制服姿の人物が映った実写風の画像を入力した際、9コマ中の複数シーンで一斉にこのエラーが出ていました。

▲ 複数カットで一斉に「Content was rejected by the platform’s safety policy. Please adjust your prompt or input and try again.」エラーが発生している様子

エラーの原因と3つの代替案

このエラーが出たとき、GensparkのAIは親切に日本語で原因と代替案を提示してくれます。拒否の主な原因は「画像に含まれる内容(学生の制服姿など)」です。リアルな人間、特に未成年と推測される人物の肖像を使った動画は、著作権・肖像権・児童保護の観点から厳しく制限される傾向があります。

▲ エラー原因と3つの代替案:「大変申し訳ございません。提供された画像からの動画生成が、プラットフォームの安全ポリシーにより拒否されました。これは画像に含まれる内容(学生の制服姿など)が原因と思われます。」

代替案としては、以下の3つのアプローチが提示されていました。実務的に使う場面では、1→3→2の順番で試すのがおすすめです。

| 代替案 | 内容 | 実務的な活用シーン |

|---|---|---|

| 1. テキストのみから動画を生成 | 画像を使わず、ストーリーの各シーンをテキストプロンプトのみで生成する方法 | 構図の自由度を残したいイメージ映像・抽象表現 |

| 2. ストーリー全体を1つの動画に凝縮 | 9つのシーンを1つに圧縮した15秒のトレーラー風動画として生成する方法 | SNS向けのティザー・ダイジェスト映像 |

| 3. 別のモデルを試す | より柔軟な安全ポリシーを持つ他モデル(Kling v3、Gemini Veo 3.1など)をGenspark内で試す | どうしても同じ画像を使いたい場合 |

実務的には、最初から「架空のキャラクターやロボット、アニメ調のキャラクター」で画像を作っておくのが最も成功率が高いです。動画内でも、ロボット・キャラクターのボス戦動画は一発で高品質に生成できていた一方、実写風の学生が登場する青春映画のシーンはほぼ全滅していました。

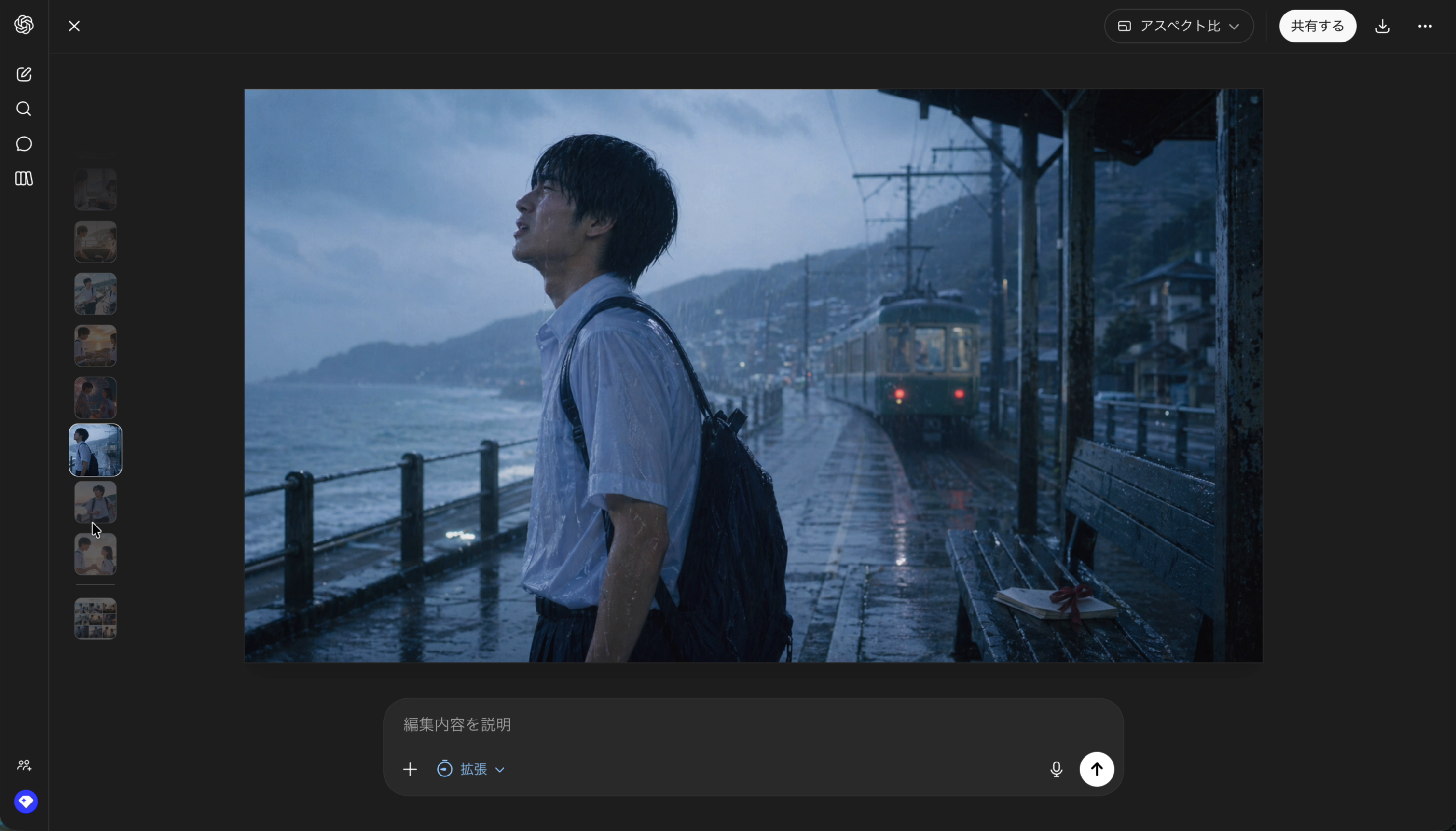

▲ 今回NGになった元画像:『青い春の向こう側』という実写風の青春映画ポスター。この実在しそうな学生の制服姿が安全ポリシーに抵触している

まとめ:得意領域と苦手領域を理解して使い倒す

SeeDance 2.0は、画像1枚を起点に映画やゲームのクオリティの動画を15秒で生成できる、現時点でトップクラスの画像from動画生成モデルです。一方で、得意領域と苦手領域のギャップが非常に大きいため、用途選びで成否がほぼ決まります。

今日押さえるべき3つのポイント

まず押さえておきたいのは、SeeDance 2.0は「画像+テキスト」から最大15秒の高品質動画を生成でき、ネイティブ音声・リップシンクにも対応していて、出力解像度は最大720p、複数アスペクト比にも対応しているという基本性能です。

次に、架空のキャラクター・ロボット・ファンタジー世界観が圧倒的に得意という特性です。AAAゲーム級のエフェクトやHUD、パーティクル、ライティングまで破綻なく再現できるので、ゲームやアニメ調のプロモ素材には即戦力になります。

最後に、実写風の人間(特に学生・未成年)は安全ポリシーで弾かれやすいという注意点です。最初の題材は架空キャラから始めるのが無難で、どうしても人物を使いたい場合はポリシーに触れない服装や年齢感の画像を用意するか、テキストのみ生成モードや別モデルへの切り替えを検討してください。

次のステップ

まずはChatGPTで「ロボット」「アニメ調キャラ」「ファンタジー戦士」などの架空キャラクター画像を1枚作り、GensparkのAI VideoでSeedance v2を選んで動かしてみてください。プロンプトで動きのシーケンス・カメラワーク・エフェクトを具体的に指示するほど、出力クオリティは跳ね上がります。

慣れてきたら、商品のPR動画やSNS用のショート動画、ゲーム・アプリのティザー映像など、実務用途に展開していくと一気に投資対効果が上がります。「画像1枚+プロンプト1本で15秒の映像素材が出てくる」という制作フローは、従来の動画制作の常識を根本から覆すレベルのインパクトを持っています。

📌 この記事が役に立ったら

ぜひ今日のうちにGensparkを開いて、SeeDance 2.0を1度触ってみてください。5分後にはあなたのPCの中で、オリジナルのキャラクターが動き出しているはずです。

コメント